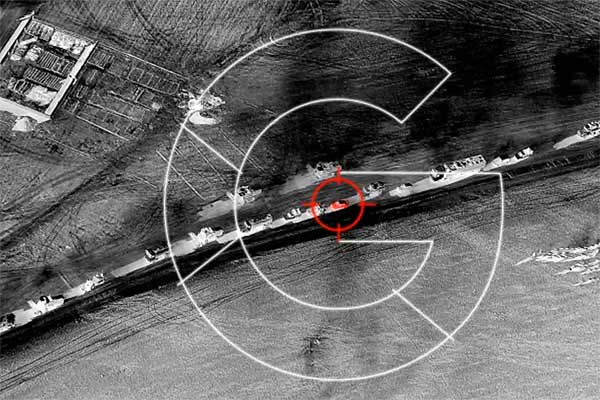

Из перечня принципов применения искусственного интеллекта (ИИ) Google изъят пункт, согласно которому корпорация ранее сама себе запрещала использовать соответствующие технологии в военных целях.

Об этом сообщает Bloomberg.

Как отмечается в публикации, до недавнего времени в данном разделе указывалось на недопустимость использования технологий ИИ, которые наносят или могут нанести ущербу, в том числе и в вооружениях.

Не пропустите: OpenAI сняла запрет на военное применение ChatGPT

Теперь же, пишет Bloomberg, в правилах, опубликованных на сайте корпорации, такой формулировки нет.

Эту новость представитель Google в официальном блоге прокомментировал следующим образом:

«Мы убеждены, что демократические государства должны выступать на передовом крае разработки ИИ, основываясь на ценностях, таких как свобода, равенство и уважение к правам человека. Мы полагаем, что компании, власти и организации, разделяющие эти идеалы, должны объединять усилия для создания ИИ, который защитит людей, будет способствовать глобальному развитию и обеспечит национальную безопасность«.

Примечательно, что экс-руководитель группы по этике ИИ Google Маргарет Митчелл также выразила тревогу в связи с такими новшествами, подчеркнув, что они не только способны нивелировать все прежние достижения в области этики применения ИИ, но и могут свидетельствовать о том, что корпорация начнет разрабатывать технологии, угрожающие жизни человека. via